| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

Tags

- 딥러닝공부

- Python강의

- supervised learning

- acmicpc.net

- JAVA강좌

- 비지도학습

- 백준 알고리즘

- Gradient Descent

- 딥러닝

- feature scaling

- 자바강좌

- 머신러닝 강좌

- 코딩테스트

- c언어 오목

- 선형회귀

- 경사하강법

- 인공지능

- 머신러닝공부

- java

- unsupervised learning

- 비용함수

- 머신러닝 강의

- 자바

- 효묘블로그

- 파이썬강좌

- 자바시작하기

- 파이썬강의

- 지도학습

- 머신러닝

- python강좌

Archives

- Today

- Total

컴공과컴맹효묘의블로그

수알못의 머신러닝 공부 : 학습률(learning rate)을 적절히 설정하는 방법 본문

반응형

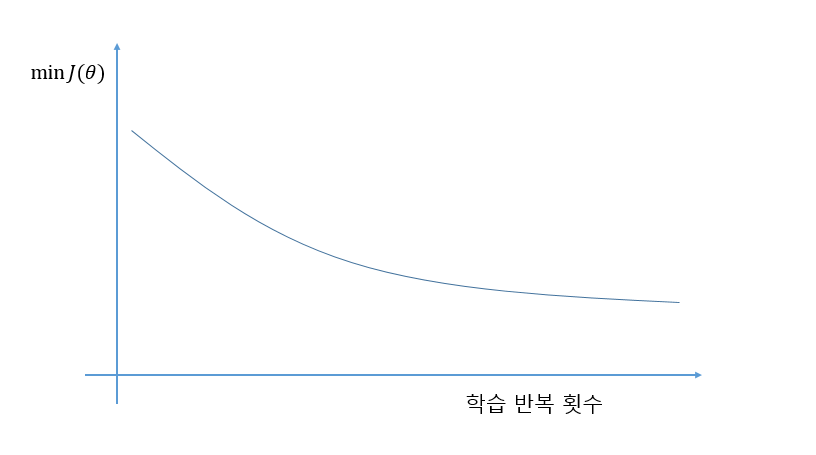

경사하강법에서 학습률이란 한번 학습할때 얼만큼 변화를 주는지에대한 상수입니다.

예를들어 부산에서 서울까지 가는데에 순간이동을 한다고 합시다. 만약 서울방향으로 10km씩 순간이동을 하면 금방 갈것입니다. 하지만 만약 1m씩 순간이동을 하면 너무 오래걸리겠죠. 그리고 1000km씩 순간이동을 하면 서울을 지나 오히려 더 멀어질것입니다. 얼마큼씩 이동할때 이 거리가 바로 학습률입니다.

이 블로그에서 처음 학습률이 등장하는 포스트 : https://hyomyo.tistory.com/13?category=820909

수알못의 머신러닝 공부 : 경사하강법

저번 시간에는 비용함수에 대해서 공부했습니다. 다시 정리하지면, 비용함수는 "오차를 표현해주는 미분 가능한 함수" 입니다. 비용함수가 오차들의(제곱의)평균이므로 오차의 최소값을 구해야겠죠? 실제로 최소값..

hyomyo.tistory.com

위에 비유한것 처럼 학습률이 너무 작으면, 학습하는데 너무 오래걸릴것이고, 혹은 학습률이 너무크면, 오차함수(비용함수)가 발산해버릴수도 있습니다.

학습률을 적절히 지정해주어야 학습을 빠르고 정확히할 수 있습니다.

그런데 문제는 학습률을 지정할 방법이 없습니다. 그냥 아무 값을 대입해보고 너무 크다싶으면 낮추고, 너무 작다싶으면 높히는 방법밖에 없답니다..

보통 3배를 증감시켜서 학습률을 맞추어 나간다고 합니다.

반응형

'컴퓨터 > 머신러닝' 카테고리의 다른 글

| Polynomail Regression 다항식 회귀 (0) | 2019.08.19 |

|---|---|

| 머신러닝 회귀 분석 Feature Scaling (0) | 2019.08.19 |

| 수알못의 머신러닝 공부 : 행렬과 벡터로 경사하강법을 (0) | 2019.07.25 |

| 수알못의 머신러닝 공부 : 역행렬과 전치행렬 (0) | 2019.07.13 |

| 수알못의 머신러닝 공부 : 행렬과 벡터_행렬곱 (0) | 2019.06.27 |

Comments